Original Method

独自メソッド

意思決定の『正当性』を、

感覚ではなく数理で証明する

DDIM™

Decision Data Integrity Model

特許出願中

DDIMは、判断の質を可視化・定量化し、社会に

対する説明責任(Accountability)を

果たすための

JDACs独自の意思決定インテグリティ検証メソッドです。

Issues

現在の意思決定が抱える3つの課題

なぜ今、意思決定の「正当性」が

問われているのか?

属人化

意思決定の根拠や反証、出典管理が個人のスキルや記憶に依存しています。その結果、組織としてのナレッジ蓄積が進まず、判断プロセスの透明性が著しく欠如しやすい状況にあります。

正当性評価不能

Explainable AI(XAI)によるAIモデルの説明はあっても、人間とAIが協調する複雑な判断プロセス全体の正当性を統合的に評価する手法が存在しません。

監査の困難さ

判断に至るロジックが構造化されていないため、事後の監査対応や再評価が極めて困難です。ステークホルダーに対する明確な説明責任(Accountability)を果たすための基盤が不足しています。

Solution

解決策

DDIM™の中核となる

4つのアプローチ

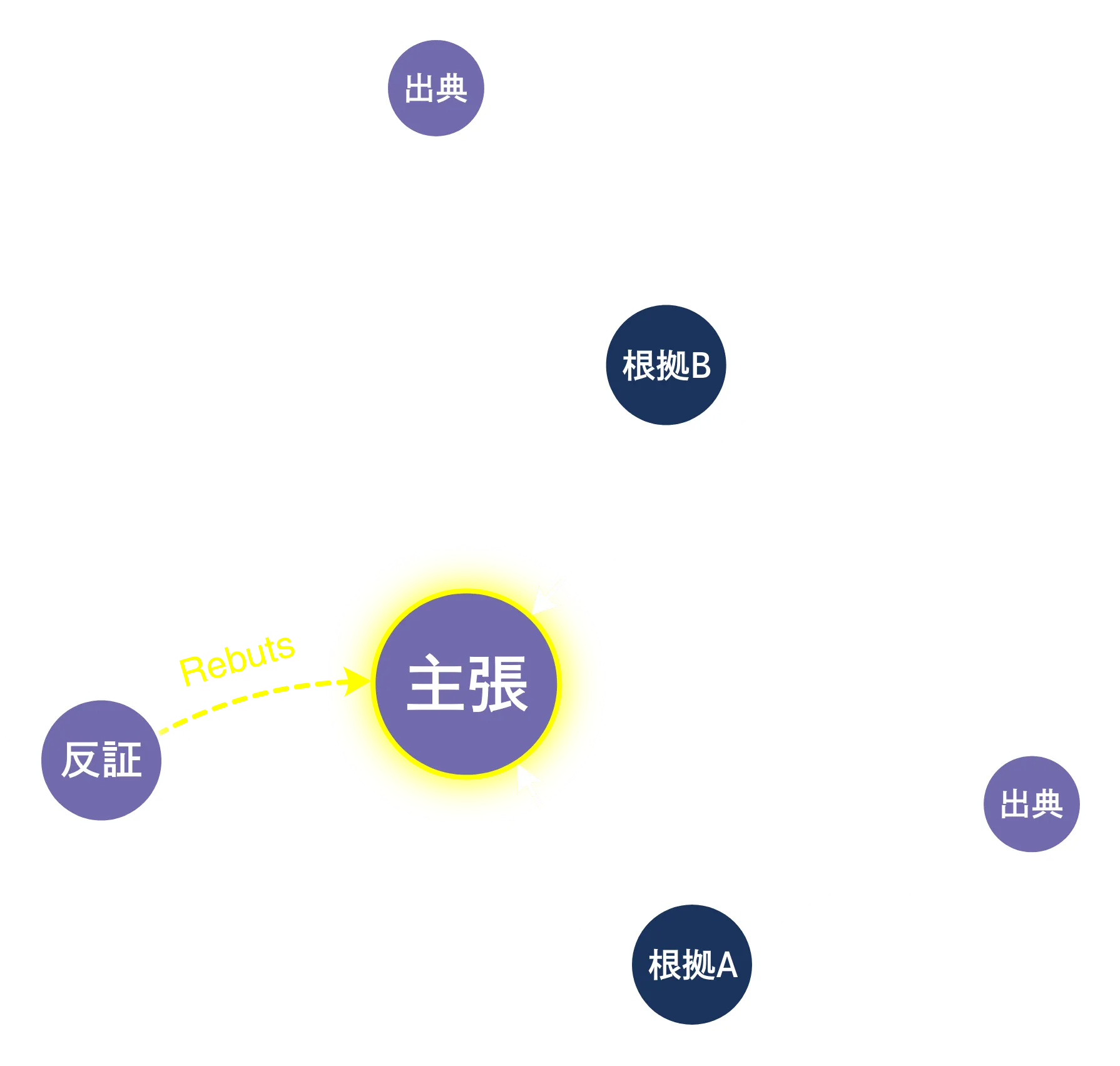

のグラフ構造化

人間とAIが関与する意思決定プロセス全体を「有向グラフ」としてモデル化。主張・根拠・データ・反証の関係性を可視化し、ブラックボックス化を防ぎます。

数理的評価

データ品質・因果整合性・倫理性・説明責任を独自アルゴリズムで定量化「なんとなく正しい」ではなく、数理的に算出された信頼度スコアを提示します。

自然言語提示

「出典不足」や「論理飛躍」などの脆弱性をシステムが自動検出し、生成AIを用いて自然言語でフィードバック。判断の質を高めるアクションを促します。

包括的評価

従来のXAI(説明可能なAI)はモデル単体の説明に留まりますが、DDIM™は人間が介在する最終判断までを含めたプロセス全体の正当性を評価します。

Technology

独自技術

意思決定の『正当性』を、

感覚ではなく数理で証明する

独自アーキテクチャ

意思決定の構造化概念

意思決定を「主張」を頂点としたグラフ構造(ネットワーク)として捉えます。数値計算ではなく、論理的骨格を可視化することで、議論の「抜け漏れ」や「ズレ」を特定します。

評価プロセス

情報の整理から構造化、多角的な品質評価、統合判断、そして改善点の提示まで、一連の体系化されたステップで実行されます。

Business Impact

導入効果

属人的・静的な判断

- プロセス

- 個人の経験や暗黙知に依存し、一度下した判断は議事録などに記録されるものの、形式的なものになりがち。

- 課題

- 新しい情報が登場しても、判断が即座に見直される仕組みがなく、状況との乖離が発生しやすい。責任の所在も曖昧になりがち。

構造化・動的に更新

意思決定の構造が可視化‧

管理されており、

変化をトリガーとして

評価が自動的に更新される。

- 新しい根拠の追加:

- 補強データの発見

- 反証の発生:

- 前提を覆す事実

- 判断条件の変化:

- 法改正‧目標変更

常に最新の情報に基づいた、

最もインテ

グリティの高い意思決定状態を維持。

最もインテ

グリティの高い意思決定状態を維持。

Use Case

活用事例

あらゆる領域で

意思決定の質を担保

経営・事業判断

- 経営判断・投資意思決定M&Aや新規事業参入におけるデューデリリジェンスの客観性を証明。

- 役員会・取締役会の監査「善管注意義務」を果たした証拠としての意思決定プロセス記録。

公共・行政

- 行政・政策判断政策決定プロセスの透明化と、市民への説明責任(Accountability)履行。

- ガバナンス・監査公的資金投入や規制策定における論理的妥当性の第三者検証。

医療・ヘルスケア

- 診断支援の説明責任AI診断支援システムと医師の判断を統合し、患者へのインフォームド・コンセントを強化。

- 治療方針決定プロセスガイドライン準拠と個別事情のバランスを可視化し、医療訴訟リスクを低減。

AI倫理・統制

- AI判断の妥当性評価ブラックボックス化しやすいAI推論に、外部知識グラフによる根拠付けを付与。

- 倫理性・公平性チェックバイアス(bi)や倫理逸脱(ui)を定量スコア化し、リリース判定に活用。

Value

提供価値

説明責任の証明

- 意思決定の説明責任(Accountability)を定量的に可視化し、ステークホルダーへの信頼を構築。

- 監査・レビュー対応を高度化・効率化し、コンプライアンスリスクを低減。

- 属人的な「勘と経験」のみに頼る判断プロセスからの脱却と標準化。

公正な判断基盤

- ブラックボックス化を回避し、AIと人間が協調する信頼可能な社会システムの構築。

- 透明性が高く、誰でも検証・再現可能な意思決定基盤の提供。

- 倫理的妥当性が担保されたAI活用の促進。

中核メソッド

- 第三者評価機関としての権威性を支える、独占的な科学的検証フレームワーク。

- セカンドオピニオンサービスにおける、客観的かつ数理的な評価基準の確立。

- デジタル・アドバイザリー戦略の品質を保証するコア技術。